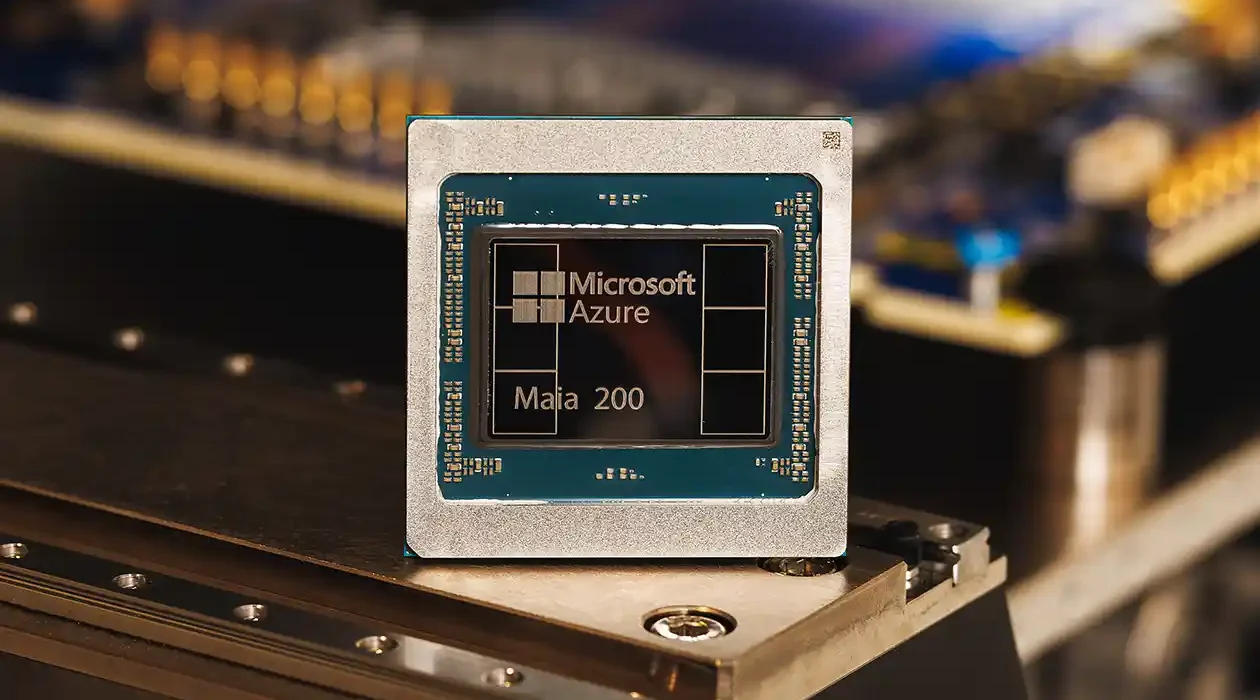

Maia 200: combinația ideală între performanță și cost‑eficiență

Microsoft a lansat Maia 200, un accelerator AI de inferență care marchează un salt major în performanță, eficiență și scalabilitate pentru modelele de inteligență artificială de ultimă generație. Construit pe tehnologia TSMC de 3 nm, Maia 200 promite să redefinească modul în care sunt generate și procesate token‑urile AI, oferind o infrastructură optimizată pentru modele precum GPT‑5.2 și pentru fluxuri complexe de date sintetice.

Acest articol îți prezintă, într-un format optimizat SEO, tot ce trebuie să știi despre Maia 200 și de ce reprezintă un punct de cotitură în ecosistemul AI.

Ce este Maia 200?

Maia 200 este un accelerator AI dedicat inferenței, proiectat pentru a maximiza performanța per watt și per dolar. Conform informațiilor oficiale, cipul include:

- Nuclee tensoriale FP8/FP4 pentru inferență de mare viteză

- 216 GB HBM3e cu o lățime de bandă impresionantă de 7 TB/s

- 272 MB SRAM pe cip

- Peste 140 de miliarde de tranzistori

Aceste specificații îl poziționează ca cel mai performant accelerator first‑party dintre toți hyperscalerii.

Performanță de top pentru inferență

Maia 200 oferă:

- >10 petaFLOPS FP4

- >5 petaFLOPS FP8

- Consum eficient într-un TDP de 750W

Microsoft afirmă că Maia 200 depășește performanțele Amazon Train Gen 3 și Google TPU v7, oferind în același timp o eficiență cu 30% mai bună per dolar față de hardware-ul actual din flota Azure.

Optimizat pentru modele mari și date sintetice

Unul dintre punctele forte ale Maia 200 este modul în care gestionează datele. Acceleratorul include:

- Un subsistem de memorie reproiectat pentru precizie îngustă

- Motor DMA specializat

- Rețea NoC de mare viteză

Aceste elemente cresc semnificativ debitul de token-uri, ceea ce îl face ideal pentru:

- Modele LLM de ultimă generație

- Generare de date sintetice

- Reinforcement learning

- Pipeline-uri AI cu latență redusă

Arhitectură scalabilă pentru centre de date

Maia 200 introduce o arhitectură de rețea pe două niveluri, construită pe Ethernet standard, care oferă:

- 2,8 TB/s lățime de bandă bidirecțională per accelerator

- Scalare până la 6.144 acceleratoare într-un singur cluster

- Comunicare previzibilă și eficientă între noduri

Această abordare reduce costurile, crește fiabilitatea și simplifică programarea pentru dezvoltatori.

Integrare nativă cu Azure

Microsoft a proiectat Maia 200 pentru a fi cloud‑native, cu:

- Validare pre-silicon avansată

- Integrare completă cu Azure control plane

- Telemetrie, securitate și management la nivel de cip și rack

Rezultatul? Modelele AI au rulat pe Maia 200 la doar câteva zile după sosirea primelor cipuri, iar timpul până la implementarea în centrele de date a fost redus la mai puțin de jumătate.

SDK Maia – un ecosistem complet pentru dezvoltatori

Microsoft pune la dispoziție un SDK dedicat, care include:

- Triton Compiler

- Suport complet pentru PyTorch

- Limbajul de programare NPL

- Simulator Maia și cost calculator

Acest pachet permite optimizarea modelelor pentru Maia 200 încă din fazele incipiente ale dezvoltării.

Disponibilitate

Maia 200 este deja implementat în:

- US Central (Iowa)

- În curând: US West 3 (Arizona)

Microsoft confirmă că vor urma și alte regiuni globale.

Concluzie

Maia 200 nu este doar un nou accelerator AI – este o platformă completă, construită pentru viitorul inferenței la scară largă. Cu performanță de top, eficiență energetică, scalabilitate masivă și integrare nativă cu Azure, Maia 200 devine un pilon central în infrastructura AI a Microsoft.

Pentru companii, dezvoltatori și cercetători, Maia 200 deschide ușa către modele mai mari, mai rapide și mai accesibile ca niciodată.